Unsloth AI выпустила Unsloth Studio для локального дообучения LLM с 70% снижением VRAM

Команда Unsloth AI выпустила Unsloth Studio — локальный no-code интерфейс для дообучения больших языковых моделей (LLM). В отличие от стандартных Python-библиотек, требующих глубокой настройки CUDA и сложных манипуляций с инфраструктурой, этот инструмент предлагает визуальную среду для полного цикла разработки: от подготовки датасетов до деплоя обученной модели.

Технический стек: оптимизация через Triton

В основе Unsloth Studio лежат кастомные бэкенд-ядра, написанные на языке OpenAI Triton. Если стандартные фреймворки часто полагаются на универсальные CUDA-ядра, то здесь используются узкоспециализированные решения, которые позволяют увеличить скорость обучения в два раза. На практике это значит, что потребление видеопамяти (VRAM) снижается на 70% при сохранении исходной точности весов модели.

Для разработчиков, использующих потребительские GPU вроде RTX 4090 или 5090, это критически важный фактор. Подобная оптимизация фактически «стирает границы» между видеокартами: теперь на одном графическом ускорителе можно дообучать модели с 8B и 70B параметрами (например, актуальные линейки Llama 3.1/3.3 или DeepSeek-R1), для которых раньше требовались целые вычислительные кластеры. Инструмент поддерживает методы эффективной настройки (PEFT), такие как LoRA и QLoRA, работающие в 4-битном и 8-битном квантовании.

Автоматизация пайплайна данных

Одной из наиболее трудоемких задач в ML является подготовка данных. В Studio внедрена система Data Recipes — узел визуального управления данными, который упрощает их сборку и трансформацию. Если коротко: разработчику не нужно вручную писать «обвесы» для форматирования.

Функционал включает поддержку мультимодального ввода — система распознает PDF, DOCX, JSONL и CSV. Благодаря интеграции с NVIDIA DataDesigner неструктурированные файлы автоматически превращаются в структурированные датасеты для обучения по инструкциям. Кроме того, инструмент берет на себя рутину по конвертации данных в стандартные спецификации типа ChatML или Alpaca, гарантируя, что модель получит корректную разметку токенов.

Поддержка GRPO и Reinforcement Learning

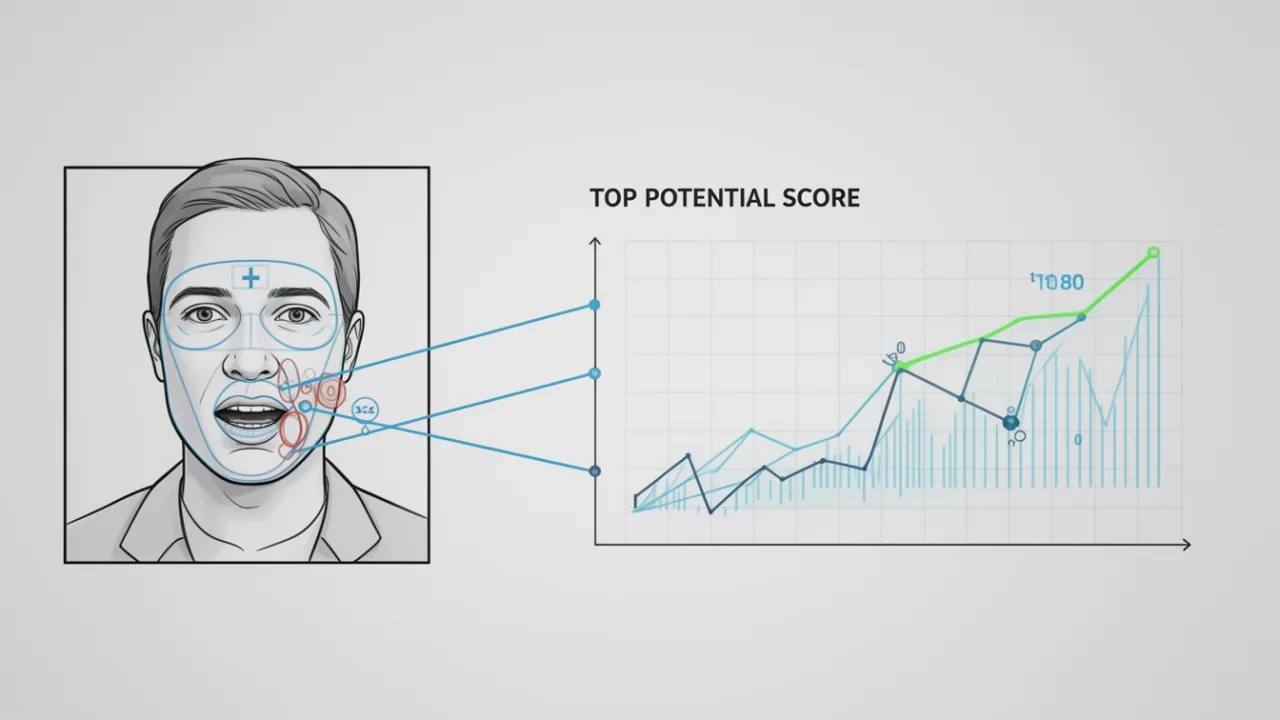

Интерфейс Studio позволяет мониторить кривые обучения и системные метрики в режиме реального времени. Помимо классического Fine-Tuning (SFT), реализована поддержка метода GRPO (Group Relative Policy Optimization). Это алгоритм обучения с подкреплением, ставший популярным после выхода моделей DeepSeek-R1. Суть GRPO в том, что оно избавляет от необходимости использовать дополнительную модель-критик (Critic), которая съедает много памяти в классическом методе PPO. В результате «рассуждающие» модели с поддержкой сложных математических вычислений становятся доступными для обучения на локальных ресурсах. На данный момент Studio поддерживает современные архитектуры, включая Llama 4 и Qwen 2.5/3.5.

Интеграция и экспорт моделей

Unsloth Studio решает проблему «разрыва» между чекпоинтом обучения и готовым к эксплуатации движком вывода. Пользователю доступен экспорт в один клик в самые востребованные форматы: GGUF (для запуска на домашних GPU/CPU), vLLM (для высоконагруженного продакшена) и Ollama (для быстрой отладки). Процесс автоматического слияния LoRA-адаптеров с базовыми весами модели проходит без потери данных, что обеспечивает консистентность весов при переходе к инференсу.

Проект придерживается философии «local-first» и доступен для Windows и Linux, позволяя разработчикам работать с конфиденциальными данными и собственными весами, не передавая их в облачные SaaS-решения.