Выпущенная 3 марта 2026 года модель Gemini 3.1 Flash-Lite позиционируется Google как инструмент для масштабируемых AI-задач, сочетающий характеристики моделей «фронтирного» уровня с кратным снижением стоимости эксплуатации. В сравнении с Gemini 3.1 Pro цена модели составила примерно одну восьмую часть, что серьезно меняет экономику высоконагруженных систем.

Архитектурные особенности и экономика модели

Flash-Lite базируется на той же архитектуре, что и Gemini 3 Pro, однако претерпела значительную дистилляцию для достижения высокой скорости и оптимизации затрат. Стоимость обработки одного миллиона входных токенов составляет $0,25, выходных — $1,50. Для аудиоданных установлена ставка $0,50 за миллион токенов. При использовании пакетной обработки (batch processing) расходы снижаются еще вдвое.Ключевым преимуществом стала поддержка контекстного окна в 1 миллион токенов при ограничении вывода в 64 тысячи токенов. На текущий момент это самый высокий показатель в данном ценовом сегменте: для сравнения, у GPT-5 mini этот параметр ограничен 400 тысячами, у Claude 4.5 Haiku — 200 тысячами токенов. Модель спроектирована с упором на пропускную способность, а не на скорость отклика одиночного запроса.

Результаты тестирования и бенчмарки

Показатели DeepMind демонстрируют высокую эффективность в задачах научно-технического профиля (GPQA Diamond — 86,9%) и мультиязычной аналитики (MMMLU — 88,9%). Тем не менее, бенчмарк SimpleQA (43,3%) указывает на склонность модели к галлюцинациям при ответе на узкие фактологические вопросы.Особое внимание стоит уделить работе с контекстом. Технология MRCR v2 показывает стабильность на уровне 128 тысяч токенов с результатом 60,1%, однако при достижении 1 млн токенов точность поиска (retrieval) снижается до критических 12,3%. Это означает, что, несмотря на формально доступный объем контекста, надежность извлечения данных при полной загрузке крайне низка.

Производительность и задержки

Пропускная способность модели составляет около 259–363 токенов в секунду, что значительно превосходит показатели конкурентов в своем классе. Это делает её оптимальным выбором для пакетной классификации, модерации контента и крупномасштабной экстракции данных.Однако показатель времени до первого токена (TTFT) составляет в среднем 6,74 секунды. В контексте интерактивных чат-интерфейсов, где критична скорость ответа, эти задержки делают использование модели нецелесообразным. Дополнительным фактором является избыточность вывода: объем генерируемых токенов превышает средние значения для аналогичных моделей в 2,5 раза, что в реальных продакшн-условиях может девальвировать ценовое преимущество, так как тарификация ведется по количеству выходных токенов.

Мультимодальные возможности и управление логикой

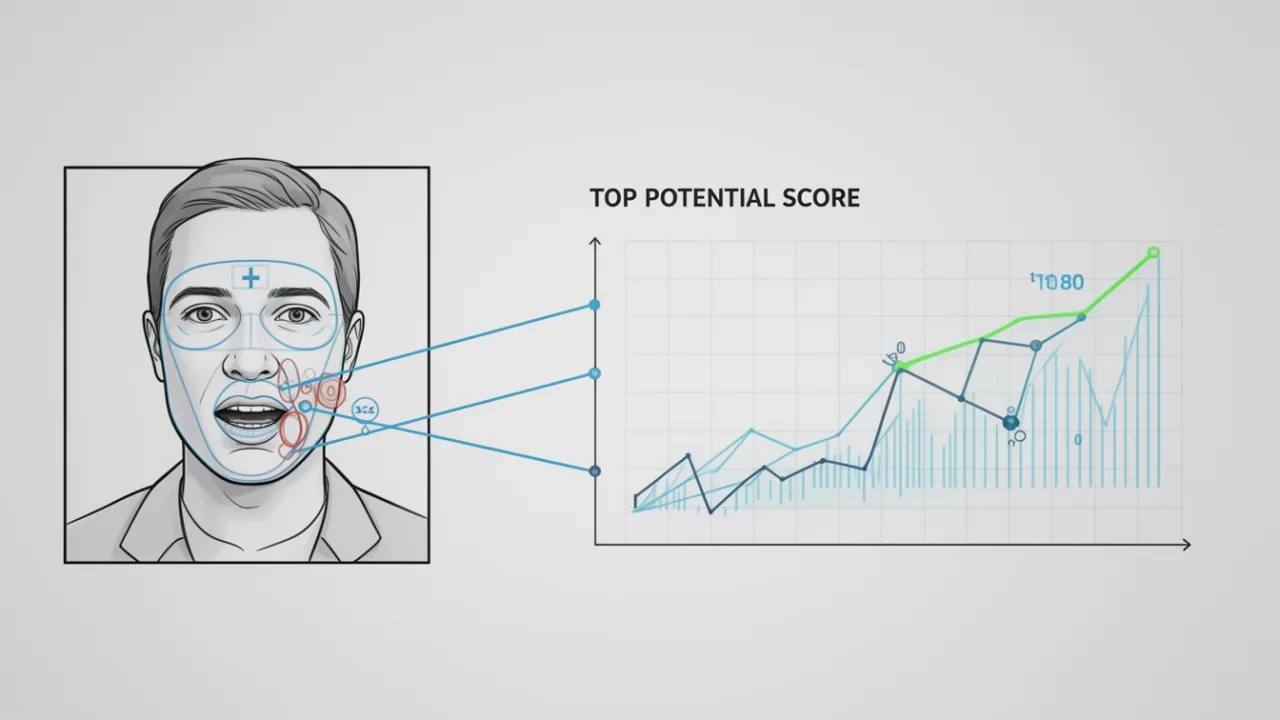

Модель принимает текст, изображения, аудио, видео и PDF, выдавая исключительно текстовый ответ. В тестах с транскрибированием аудио (в частности, 45-минутных встреч) Flash-Lite показывает высокое качество распознавания речи и синтеза резюме. Работа с видео (Video-MMMU — 84,8%) и парсинг PDF-отчетов остаются сильными сторонами модели.Пользователь может выбирать уровень «мышления» (от минимального до высокого). Увеличение глубины рассуждений прямо влияет на стоимость и задержку, однако существенно снижает количество логических ошибок при генерации структурированного вывода. Рекомендуемым параметром для аналитических задач является средний уровень (medium).

Риски и ограничения

На текущем этапе модель имеет статус «превью» (pre-GA). Это исключает наличие соглашений об уровне обслуживания (SLA) и гарантирует возможность внесения существенных изменений в API. Также отмечается регрессия в безопасности при работе с изображениями (-21,7% по сравнению с версией 2.5 Flash-Lite), хотя показатели необоснованных отказов в ответах улучшились.Из-за архитектурных особенностей модель рекомендуется использовать для:

— массовой классификации документов;

— ранжирования в RAG-системах;

— пакетной транскрипции аудио;

— генерации структурированных ответов.Использование для интерактивного общения, сложных цепочек логических рассуждений или приложений с высокими требованиями к SLA на данный момент является нецелесообразным.