Эта неделя в исследованиях ИИ ознаменовалась выходом трех работ, которые подвергают сомнению устоявшиеся методы оценки и оптимизации моделей. Основной посыл публикаций заключается в том, что существующие подходы к рассуждениям, оценке мультимодальных систем и использованию LLM в качестве судей часто демонстрируют лишь поверхностную эффективность, скрывая серьезные концептуальные дефекты.

ReBalance: решение проблем «передумывания» и «недодумывания»

Исследовательская группа представила метод *Efficient Reasoning with Balanced Thinking*, направленный на минимизацию ошибок в процессе генерации цепочек рассуждений. Традиционно считается, что увеличение количества шагов размышления прямо пропорционально качеству ответа. Однако на практике модели сталкиваются с двумя полярными состояниями: они тратят лишние вычислительные ресурсы на простых задачах («передумывание») или выдают необоснованно уверенные, но поверхностные ответы на сложных («недодумывание»).Решение ReBalance заключается в использовании сигналов уверенности как динамического регулятора («циферблата») в процессе вывода. Технические особенности метода не требуют переобучения весов модели. Разработчики создали «прототипы режимов рассуждения» — шаблоны, соответствующие паттернам активации нейросети при ошибках обоих типов. В ходе инференса система извлекает скрытые состояния и применяет векторы коррекции, отталкиваясь от переменчивости (вариативности) уверенности модели. Если модель постоянно сомневается, система это распознает, если излишне самоуверена — также вносит коррективы. Тестирование на 9 бенчмарках и моделях от 0,5B до 32B параметров показало, что такой подход позволяет сократить длину вывода при сохранении или росте точности прогнозов.

CRYSTAL: прозрачность мультимодальных рассуждений

В работе *Beyond Final Answers: CRYSTAL Benchmark for Transparent Multimodal Reasoning Evaluation* авторы указывают на то, что оценка только финального ответа в мультимодальных задачах является методологически недостаточной. Новый бенчмарк CRYSTAL содержит более 6 тысяч примеров, оценивающих промежуточные шаги рассуждений на предмет полноты и логической последовательности.Исследователи применили метрики *Match F1* и *Ordered Match F1*. Последняя выявляет критическую проблему: многие современные модели генерируют верные фрагменты аргументации, но нарушают их логический порядок. Данные тестов по 20 системам подтвердили, что ни одна из них не сохраняет более 60% верной последовательности шагов. Часто модели «выдергивают» из контекста правильные элементы, игнорируя связность процессов. Для борьбы с этим предложена функция вознаграждения *Causal Process Reward (CPR)*, которая заставляет модель связывать результат с процессом мультипликативно, а не аддитивно, что не дает системе «обманывать» систему обучения, выбирая наиболее простой путь к получению баллов.

Ловушка LLM-судей

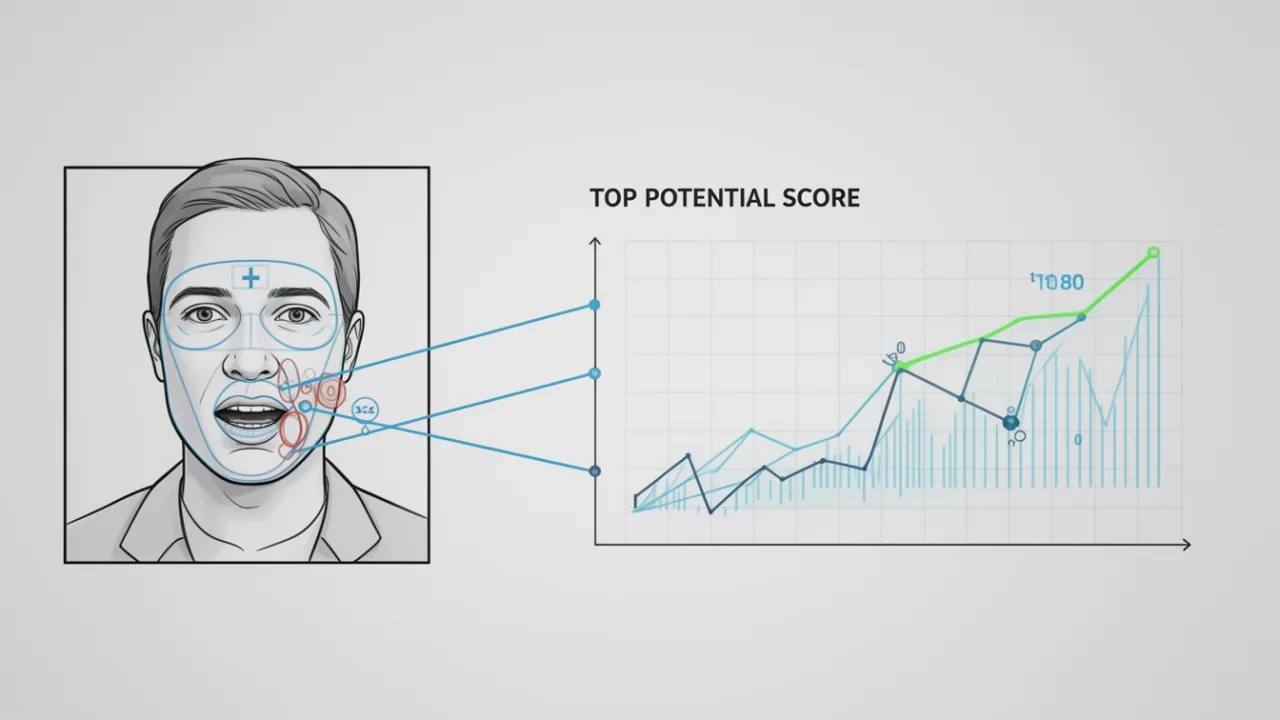

Публикация *When LLM Judge Scores Look Good but Best-of-N Decisions Fail* анализирует эффективность использования LLM для ранжирования ответов. Устоявшаяся практика оценки таких «судей» через глобальную корреляцию с предпочтениями человека оказалась обманчивой.Анализ показал, что модель-судья с достойным коэффициентом глобальной корреляции (r = 0,47) в реальности «улавливает» лишь 21% от потенциального улучшения, которое дала бы идеальная стратегия отбора ответов. Проблема кроется в том, что глобальные метрики маскируют неспособность модели различать ответы внутри одного и того же запроса. Из-за использования грубой шкалы (например, от 1 до 10) в 67% случаев возникают «программные ничьи», превращающие выбор в случайный процесс. Автор предлагает перейти от независимого скоринга к прямому попарному сравнению ответов. На практике это позволило поднять эффективность отбора с 21,1% до 61,2%. Эти данные ставят под сомнение адекватность использования текущих стандартных методов валидации в RLHF-пайплайнах.Общий тренд этих работ указывает на то, что текущие метрики и оценочные архитектуры часто оптимизированы не под реальную работоспособность моделей, а под удобные, но не репрезентативные показатели. Для IT-сектора это означает необходимость пересмотра базовых принципов оценки качества генеративных систем.