Mistral AI анонсировала Small 4: MoE-модель на 119 млрд параметров под Apache 2.0

На конференции GTC 2026 компания Mistral AI представила фундаментально новую модель Mistral Small 4, а также анонсировала вступление в Nemotron Coalition — альянс, организованный совместно с NVIDIA. Обновления касаются как архитектурных решений, подходов к управлению вычислительными ресурсами, так и стратегии развития «открытых фронтирных моделей».

Архитектурные особенности: путь к гранулярности

В основе Mistral Small 4 лежит архитектура Mixture-of-Experts (MoE) с общим объемом 119 млрд параметров. Ключевая особенность реализации заключается в высокой степени разреженности: на каждый токен задействуется лишь 6 млрд активных параметров (8 млрд с учетом эмбеддингов). Инженеры Mistral радикально увеличили количество экспертов до 128, при этом для обработки одного токена активируются только 4 из них. Такая компоновка позволяет модели использовать совокупную «базу знаний» огромного массива параметров, сохраняя при этом стоимость инференса на уровне компактных 7-миллиардных моделей.

По сравнению с предыдущей итерацией (Small 3), новинка демонстрирует 40-процентное снижение задержки и трехкратный прирост пропускной способности. Модель поддерживает контекстное окно в 256 тыс. токенов, является мультимодальной (обработка текста и изображений) и распространяется под лицензией Apache 2.0.

Конфигурируемое рассуждение

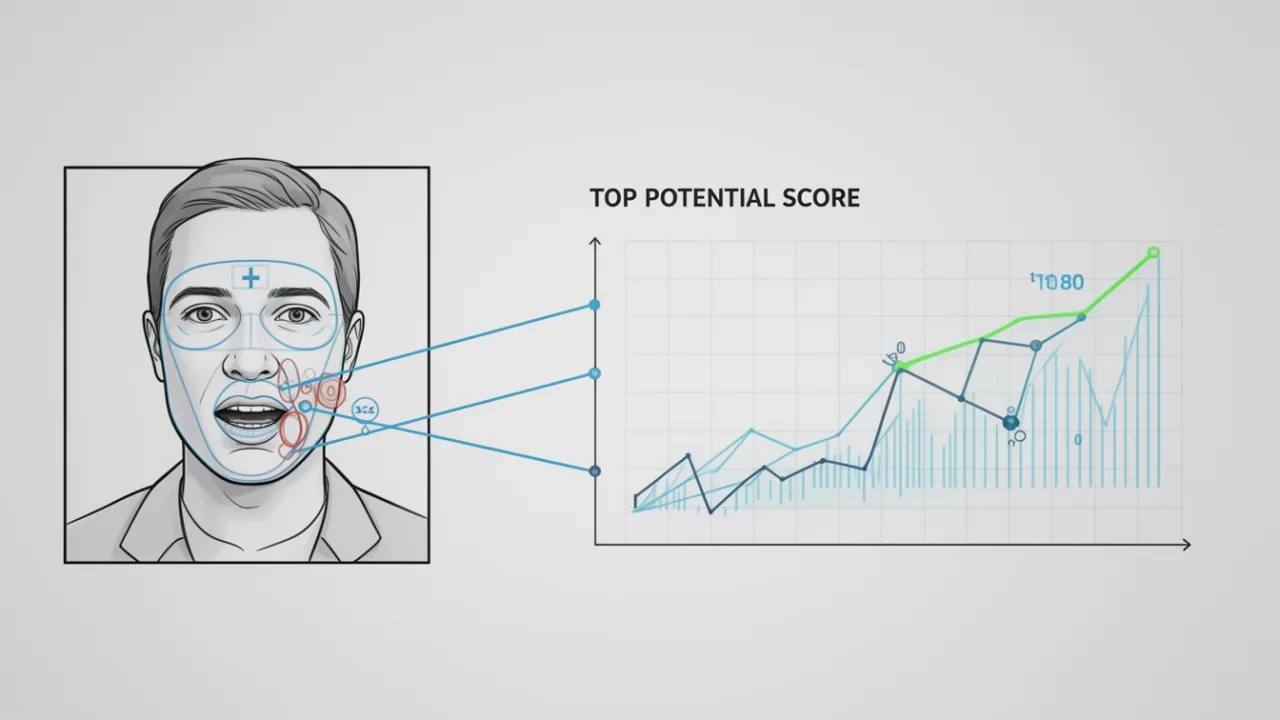

С технической точки зрения наиболее значимым новшеством стала настройка reasoning_effort. Разработчикам больше не требуется поддерживать инфраструктуру для нескольких разных моделей, чтобы балансировать между скоростью и глубиной анализа. Параметр позволяет переключаться между режимами «none» (прямые ответы с минимальным потреблением токенов) и «high» (пошаговая цепочка рассуждений, аналогичная по сложности специализированным моделям уровня Magistral).

Проще говоря, один API-вызов теперь заменяет систему роутинга запросов. На бенчмарке логических рассуждений (LCR) Mistral Small 4 показывает точность 0.72 при генерации 1.6 тыс. символов. Для достижения сопоставимых результатов моделям семейства Qwen требуется в 3.5–4 раза больше выходных токенов, что напрямую конвертируется в экономию затрат на инференс.

Альянс с NVIDIA и Nemotron Coalition

Партнерство с NVIDIA официально оформлено через создание Nemotron Coalition. Помимо Mistral, в объединение вошли Black Forest Labs, Cursor, LangChain, Perplexity, Reflection AI, Sarvam и Thinking Machines Lab. Цель инициативы — создание фронтирных моделей с открытыми весами. Mistral отвечает за архитектуру MoE и методологии обучения, в то время как NVIDIA предоставляет вычислительные мощности DGX Cloud, конвейеры синтетических данных и инструменты развертывания через NIM (NVIDIA Inference Microservices).

Сотрудничество фактически закрепляет статус Mistral как ключевого партнера NVIDIA в сегменте open-weight моделей, обеспечивая доступ к вычислительным ресурсам, требующим многомиллионных инвестиций, в обмен на разработку базиса для будущей линейки продуктов Nemotron 4.

Аппаратные требования и практические ограничения

Несмотря на «малый» статус в названии, для локального развертывания Mistral Small 4 требуются значительные мощности. Поскольку все 119 млрд параметров должны быть загружены в VRAM, минимальный порог входа — 4x HGX H100, 2x HGX H200 или 1x DGX B200. Рекомендуемая конфигурация предполагает использование 4x HGX H200 или 2x DGX B200. На практике это делает self-hosting доступным преимущественно для enterprise-сегмента, в то время как остальные разработчики будут использовать облачные API или managed-решения.

Аналитики также отмечают избирательность бенчмарков: Mistral делает упор на LCR, LiveCodeBench и AIME 2025, где MoE-архитектуры традиционно показывают лучшие результаты, при этом данные по MMLU или GPQA остаются в тени. Кроме того, на текущий момент Nemotron Coalition существует как декларация о намерениях: совместная модель еще не разработана, и речь идет о долгосрочных обязательствах, а не о готовом к эксплуатации продукте.

На данный момент Mistral Small 4 доступна для работы через API компании, Hugging Face, платформу build.nvidia.com, а также интегрирована с популярными библиотеками логического вывода вроде vLLM, SGLang и llama.cpp.