Модели проводят до 100 видеозвонков в день для AI-скамов с дипфейками

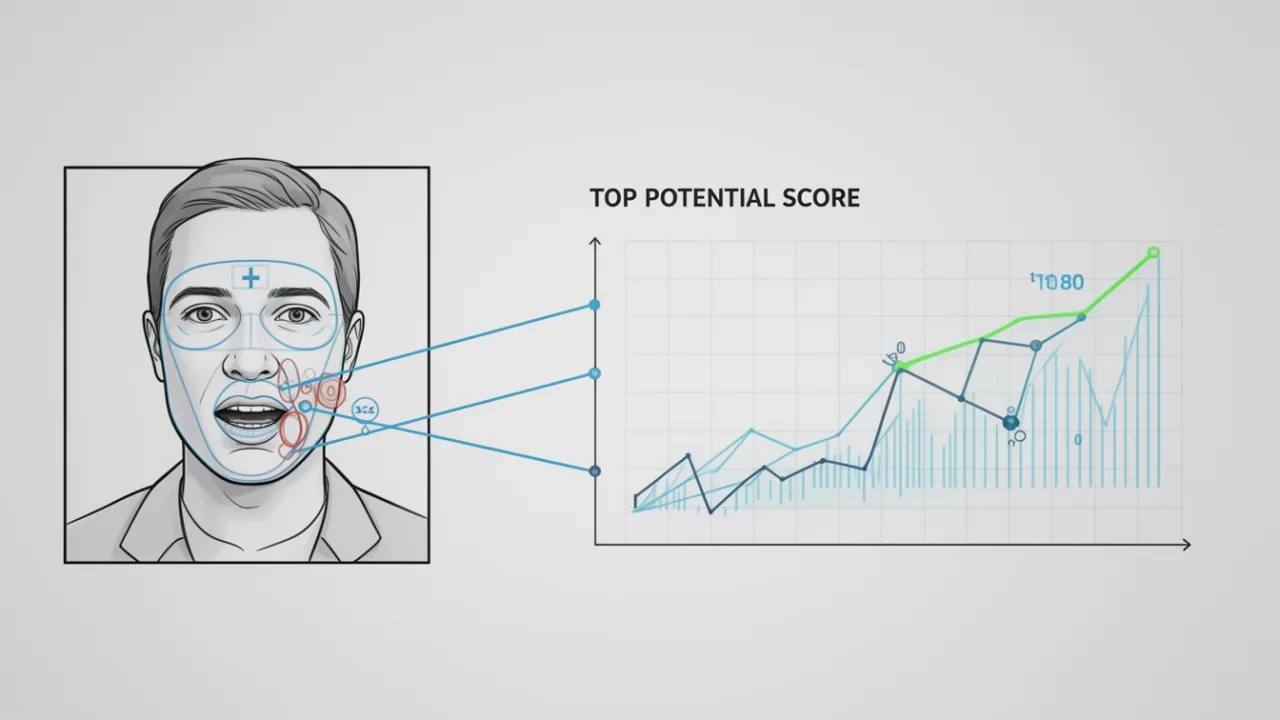

Индустрия киберпреступности перешла на новый уровень автоматизации: злоумышленники начали активно нанимать реальных людей для создания «цифровых двойников», которые в дальнейшем используются в схемах с применением дипфейков. Суть процесса заключается в краудсорсинге лиц и голосов: операторы скам-проектов ищут кандидатов, готовых за небольшое вознаграждение предоставить свои биометрические данные для обучения нейросетевых моделей.

Масштабирование мошеннических операций через живые дипфейки

На практике это значит, что мошенники перестали ограничиваться генерацией синтетических персонажей «с нуля». Вместо этого они формируют обширные базы данных из реальных людей, превращая последних в «лицо» автоматизированных систем обмана. Исполнители проходят через серию видеозвонков — иногда до 100 сессий в день — необходимых для качественной калибровки дипфейк-инструментов. В дальнейшем эти модели используются для имитации общения с жертвами, позволяя преступникам транслировать убедительную картинку в режиме реального времени.

Синтетические личности в криминальной экосистеме

Использование таких технологий глубоко интегрировано в современный ландшафт киберугроз. Помимо стандартных финансовых махинаций, злоумышленники применяют AI-инструменты для создания специализированных чат-ботов. Примечательно, что преступная среда быстро осваивает узкие ниши: технологии генеративного ИИ востребованы даже для автоматизированных сценариев, ориентированных на специфические запросы пользователей, включая сферу интимных ролевых игр, для максимизации вовлеченности потенциальных жертв.

Кибербезопасность в эпоху дипфейков

Если коротко, угроза сместилась от простых фишинговых рассылок к глубокой психологической манипуляции на основе высококачественной генерации контента. Схемы, связанные с криптовалютой и доверительным инвестированием, стали эффективнее благодаря использованию «живых» дипфейков, которые крайне сложно отличить от реального собеседника при поверхностном осмотре. Экспертиза в области безопасности указывает на то, что привлечение людей к производству таких материалов — это новая форма социального инжиниринга, где обычные пользователи фактически становятся соучастниками криминальных схем, зачастую осознавая лишь малую часть того, для чего именно используются их биометрические данные.