Tongyi Lab выпустила открытую модель Fun-CineForge для кинодубляжа

Лаборатория Tongyi, подразделение Alibaba, представила мультимодальную модель Fun-CineForge, ориентированную на профессиональный кинодубляж. Разработка переводит возможности генеративного ИИ из области простых голосовых помощников в сферу сложного постпродакшна анимации и игрового кино. Релиз включает как саму модель, так и методику формирования обучающей выборки, что закрывает распространенные проблемы автоматизированной озвучки: рассинхронизацию губ (лип-синк), безликую эмоциональную окраску и сложности с удержанием тембра персонажа в диалогах.

Технологические особенности и «временная модальность»

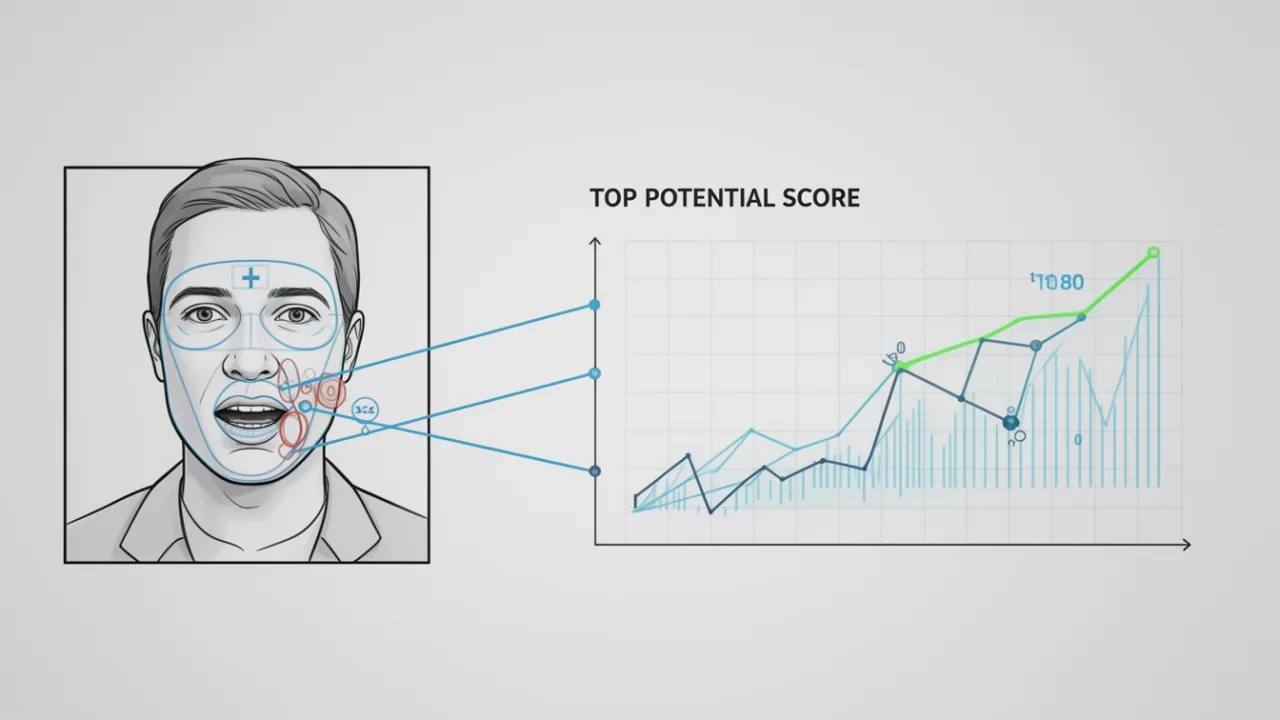

Ключевым архитектурным решением в Fun-CineForge стало внедрение «временной модальности». Если стандартные модели опираются преимущественно на текстовый контекст или визуальные признаки, то здесь акцент смещен на прецизионный контроль меток времени. Проще говоря, система жестко привязывает синтезированную речь к заданным временным интервалам. На практике это позволяет сохранять высокую точность аудиовизуальной синхронизации даже в динамичных сценах: когда лицо персонажа перекрыто объектами, камера резко меняет ракурс или картинка размыта. Система сохраняет стабильность интонаций и качественное соответствие видеопотоку независимо от сложности монтажа.

Автоматизация разметки данных

Одновременно с моделью был представлен набор данных CineDub и методология его создания, что является критически важным для обучения нейросетей такого класса. Специалисты Tongyi Lab применили технологию «цепочки рассуждений» (chain-of-thought) для автоматизации первичной обработки видеоматериалов. Это позволило отказаться от ручной разметки в пользу алгоритмической структуризации входных данных. Согласно технической документации, такой подход минимизирует количество ошибок в транскрипции до 1%, а точность разделения дикторов достигает 98,8%. Подобная чистота данных существенно повышает качество итогового инференса.

Масштабируемость и область применения

На текущем этапе развития Fun-CineForge поддерживает обработку видеоклипов длительностью до 30 секунд. Инструментарий адаптирован не только для линейных монологов, но и для сложных многоголосых сцен, включая дуэты и диалоги нескольких персонажей, что ранее было труднодостижимой планкой для ИИ-решений. Исходный код и веса модели уже доступны на основных профильных площадках, включая GitHub, HuggingFace и ModelScope, что позволяет разработчикам интегрировать технологию в существующие пайплайны производства медиаконтента.

GitHub: https://github.com/FunAudioLLM/FunCineForge

HuggingFace: https://huggingface.co/FunAudioLLM/Fun-CineForge

ModelScope: https://www.modelscope.cn/models/FunAudioLLM/Fun-CineForge/