Искусственные ссылки проходят рецензирование на ведущих конференциях по ИИ и новый открытый инструмент хочет это исправить

Проблема галлюцинаций в научных исследованиях вышла на новый уровень: фиктивные ссылки на несуществующие работы начали проникать в материалы крупнейших конференций по искусственному интеллекту. Для борьбы с этим явлением разработан инструмент CiteAudit — система с открытым исходным кодом, предназначенная для автоматизированной проверки библиографических списков. Проблема усугубляется тем, что современные языковые модели генерируют убедительные названия трудов и реалистичные составы авторов, а раздутые объемы цитирований в современных статьях делают ручную проверку практически невозможной для рецензентов.

Архитектура и методология CiteAudit

В основе CiteAudit лежит многостадийный процесс, за который отвечают пять специализированных ИИ-агентов. Работа начинается с «агента-экстрактора», который извлекает из PDF-файла метаданные: заголовки, имена авторов и названия конференций. Затем «агент памяти» сверяет данные с уже проверенными источниками, чтобы исключить дублирование задач. Если совпадений нет, в дело вступает «поисковый агент», анализирующий результаты выдачи Google Search API. Далее «агент-судья» проводит посимвольное сравнение извлеченных данных с найденными доказательствами. В спорных ситуациях подключается «агент-ученый», который обращается к авторитетным базам данных, таким как Google Scholar. Вся логическая обработка задач в системе реализована на базе локально развернутой модели Qwen3-VL-235B.

Для обучения и тестирования системы исследователи сформировали датасет, включающий 6 475 подлинных и 2 967 сгенерированных цитат. Галлюцинации создавались с помощью GPT, Gemini, Claude, Qwen и Llama, а реальные примеры ошибок были собраны из публикаций на Google Scholar, OpenReview, ArXiv и BioRxiv. В классификацию вошли различные типы подделок: от тонкой подмены ключевых слов в заголовках до полной фабрикации DOI-номеров и названий конференций.

Сравнительный анализ эффективности

В ходе лабораторных тестов коммерческие модели показали неплохие результаты: например, GPT-5.2 распознала 91% фейковых ссылок, не допустив ни одной ошибки на массиве из 3 586 подлинных источников. Однако в условиях работы с реальными текстами точность проприетарных решений падает. При анализе 467 обнаруженных «в дикой природе» галлюцинаций GPT-5.2 выявила 78% из них, но при этом ошибочно пометила как подделки почти половину качественных ссылок (1 380 из 2 889). Аналогичные проблемы с ложноположительными срабатываниями наблюдались у GPTZero и Gemini 3 Pro.

CiteAudit продемонстрировала более высокую стабильность, корректно определив все 467 подделок и допустив лишь 100 ложных срабатываний на списке из почти трех тысяч реальных работ. Итоговая точность системы составила 97,2%. С технической точки зрения решение выглядит предпочтительнее для массовых проверок: обработка десяти ссылок занимает всего 2,3 секунды, а использование локальной модели снимает вопрос затрат на API-токены.

Масштаб проблемы в академической среде

Исследования подтверждают, что галлюцинированные ссылки — это не теоретическая угроза, а реальность рецензируемых изданий. Подобные артефакты уже находили в статьях на конференциях уровня NeurIPS и ACL. Инспекция GPTZero выявила более 50 несуществующих источников только в заявках на ICLR 2026. Ситуация осложняется тем, что нейросети часто не способны критически оценивать собственные или чужие генерации. Ранее тесты Newsguard показали, что ChatGPT, Gemini и Grok в большинстве случаев не могут идентифицировать видео, созданные моделью Sora, выдавая уверенные, но ложные ответы и иногда даже выдумывая новости для подтверждения фейковых событий.

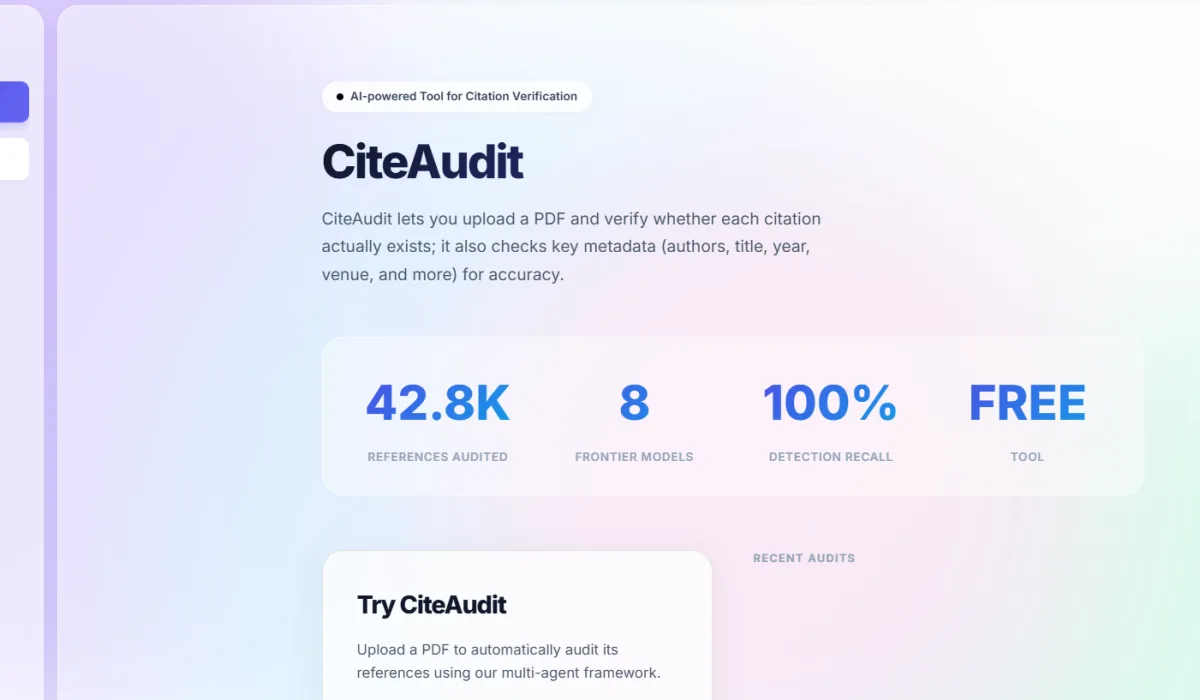

Разработчики CiteAudit сделали инструмент доступным в виде веб-приложения. Пользователи могут проверять до 500 цитат в день бесплатно после регистрации, а для более масштабных задач предусмотрена возможность подключения собственного API-ключа Gemini. Проект позиционируется как первый открытый бенчмарк и система обнаружения, призванная восстановить доверие к доказательной базе научных публикаций.

Сайт сервиса: https://www.checkcitation.com/

Большая статья по инструменту доступна по ссылке: https://arxiv.org/html/2602.23452