Tokenmaxxing снижает продуктивность разработчиков

В среде разработчиков набирает популярность термин «tokenmaxxing», обозначающий практику массового делегирования написания кода большим языковым моделям (LLM). Визуально это выглядит как экспоненциальный рост объема создаваемого кода, однако на практике подобный подход зачастую оборачивается снижением общей продуктивности инженерных команд. Ключевая проблема заключается в том, что количество сгенерированных строк обратно пропорционально их качеству и, как следствие, пригодности для эксплуатации.

Реальные издержки «автоматизированного» кодинга

Если говорить проще, то LLM работают как энтузиасты без должного опыта или понимания контекста конкретного проекта. Полученный первичный результат нередко оказывается избыточным, неэффективным и содержащим архитектурные упущения. Вместо экономии времени разработчики вынуждены тратить рабочие часы на глубокий рефакторинг, отладку и приведение «сырого» кода к продакшн-стандартам. По сути, время, уходящее на «зачистку» артефактов модели, часто превышает затраты на написание аналогичного модуля с нуля человеком.

С финансовой точки зрения «tokenmaxxing» создает скрытые издержки. Даже если стоимость запроса к API кажется незначительной, суммарное время инженера, потраченное на исправление ошибок и дополнительный код-ревью низкокачественных блоков, нивелирует всю первоначальную выгоду. Как отмечают специалисты, проблема заключается не только в скорости доставки фич, но и в общей надежности системы, где плотность багов в сгенерированных фрагментах оказывается выше ожидаемой.

Ловушка быстрых решений

Разработчики нередко оказываются под жестким давлением сроков сдачи проектов, что провоцирует использование нейросетей как «кратчайшего пути». На практике это срабатывает как ловушка: попытка ускорить старт через генерацию больших массивов кода в конечном итоге приводит к необходимости переработки созданного «хаоса». Команды обнаруживают, что вместо изначальной экономии ресурсов они тратят вдвое больше времени на ликвидацию последствий необдуманного внедрения AI-инструментов.

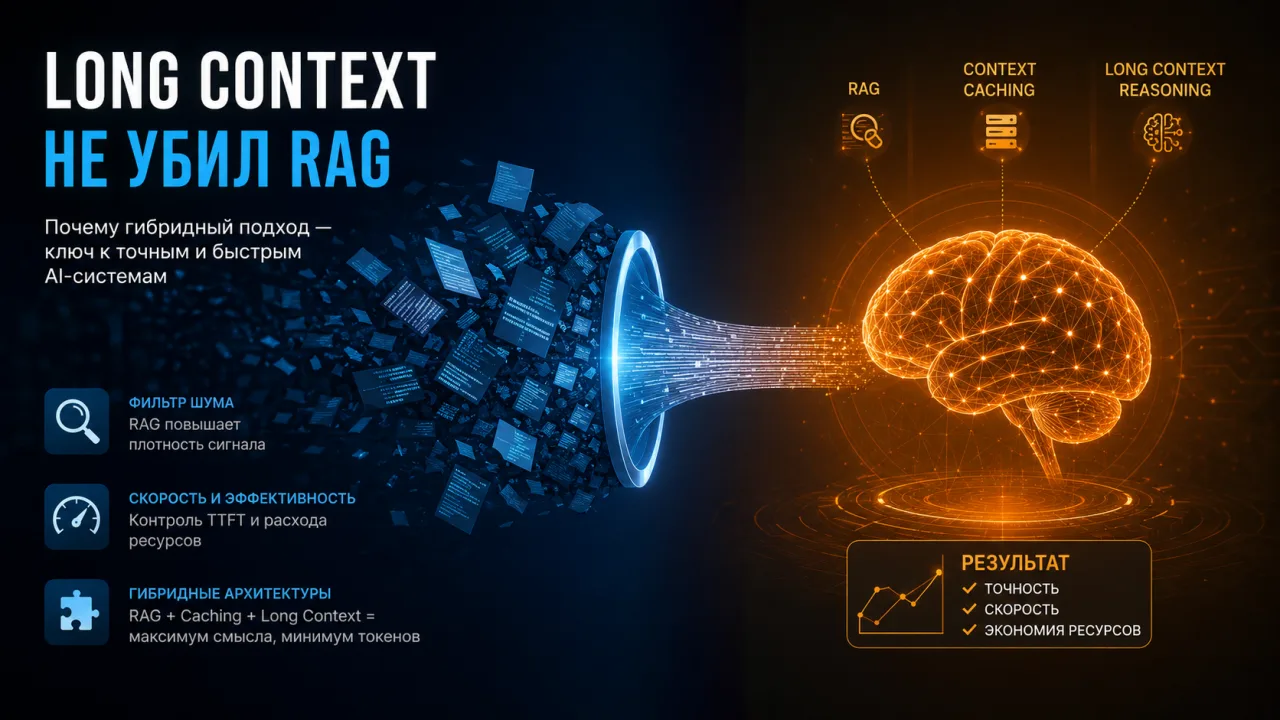

Гибридный подход как средство контроля

Текущая реальность таковая, что LLM не являются заменой профессиональной экспертизе, а лишь инструментом, требующим осознанного применения. Вместо того чтобы полагаться на модели как на полноценных авторов кода, разработчикам стоит рассматривать их как вспомогательный механизм для генерации идей, прототипирования или создания шаблонных заготовок. Оптимальная стратегия заключается в использовании сильных сторон обеих сторон: автоматизация берет на себя рутину, а инженер осуществляет архитектурный контроль, критическую проверку и финальную оптимизацию системы.

При интеграции LLM в рабочие процессы специалистам необходимо сохранять бдительность. Погоня за максимизацией токенов — это прежде всего тактический проигрыш, если за ним не стоит стратегии глубокого анализа качества контента. Инструменты автоматизации должны дополнять рабочий цикл, а не подменять собой инженерную экспертизу, способную учитывать специфику и ограничения конкретного проекта.