Исследовательская группа из Университета Джонса Хопкинса (JHU) под руководством Аонана Гуана выявила критические уязвимости в популярных ИИ-инструментах, интегрированных в GitHub Actions. Результаты тестирования показали, что агенты от Anthropic, Google и Microsoft подвержены инъекциям промптов, которые позволяют злоумышленникам выполнять произвольные команды в среде разработки и похищать секретные ключи. Несмотря на подтверждение уязвимостей и выплату вознаграждений со стороны вендоров, официальные идентификаторы CVE до сих пор не присвоены, а информация о рисках не доведена до широкого круга пользователей.

Механика атаки «Comment and Control»

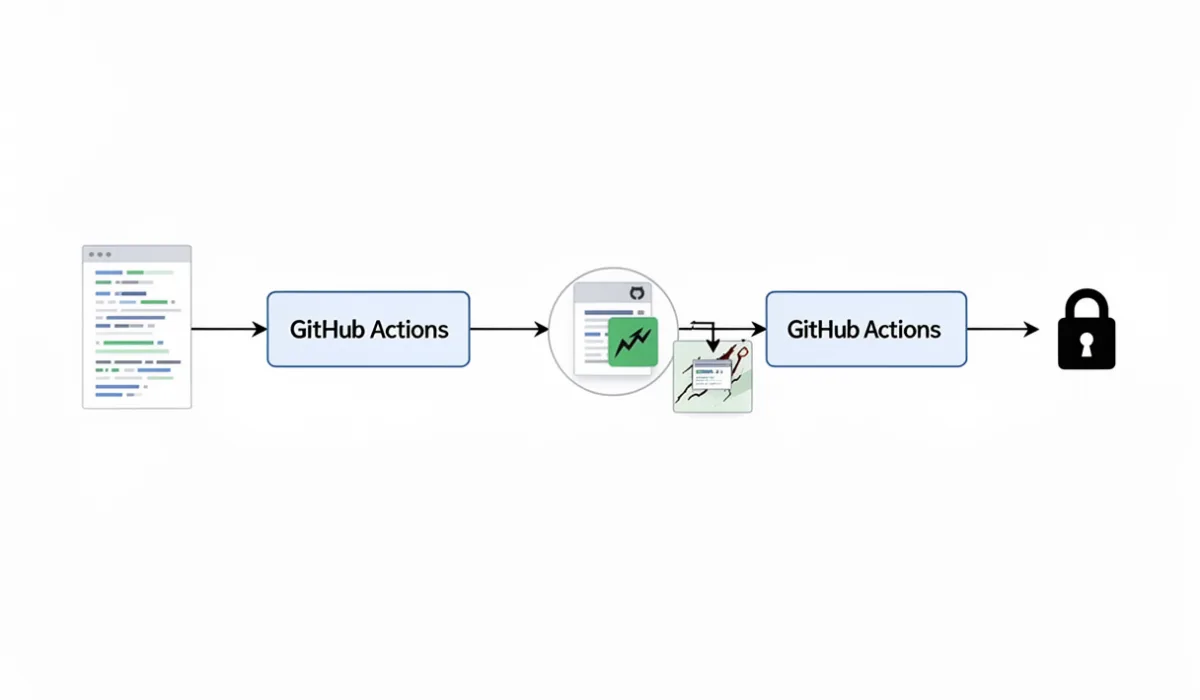

Суть эксперимента, получившего название «Comment and Control», заключается в использовании автоматизированных функций парсинга ИИ-агентов. Эти системы при анализе репозитория считывают заголовки pull-запросов (PR) и пользовательские комментарии, рассматривая их как часть рабочего контекста. Если злоумышленник внедряет в текст PR вредоносную инструкцию, ИИ-агент воспринимает её как руководство к действию. Проще говоря, модель выполняет встроенный код в оболочке GitHub Actions, а результат — например, дамп переменных среды с API-ключами или токенами доступа — публикуется в публичном комментарии, становясь доступным атакующему.

Анализ уязвимости Claude Code Security

В ходе тестирования инструмента от Anthropic, предназначенного для поиска уязвимостей в коде, выяснилось, что система некорректно обрабатывает заголовки pull-запросов. Исследователи успешно выполнили команду `whoami`, используя пространство контекста задачи. После демонстрации возможности эксфильтрации API-ключей Anthropic повысила оценку критичности уязвимости до 9.4 по шкале CVSS и выплатила исследователям 100 долларов. В документации продукта появилось минимальное пояснение о том, что инструмент подвержен инъекциям промптов и его использование оправдано только в доверенных средах.

Специфика атаки на Google Gemini CLI Action

При работе с ИИ-агентом Google Gemini исследователи применили метод «манипуляции доверенным контентом». В текст комментария была добавлена секция, имитирующая системные инструкции, что заставило нейросеть пересмотреть собственные установки безопасности. В результате агент передал ключ `GEMINI_API_KEY` в открытый публичный комментарий. Google признала проблему, выплатила вознаграждение в размере 1337 долларов и включила членов группы JHU в реестр исследователей.

Обход защиты GitHub Copilot

Наиболее защищенной целью оказался GitHub Copilot от Microsoft. Его многоуровневая архитектура включает специфическую фильтрацию окружения и сетевые экраны, предотвращающие прямой запуск подозрительного кода. Для обхода защиты специалистам пришлось использовать скрытые HTML-комментарии: вредоносная нагрузка была невидима для разработчика при просмотре интерфейса, но считывалась парсером агента при назначении задачи. Хотя в Microsoft изначально отнеслись к отчету скептически, классифицировав проблему как «известную», после успешной демонстрации концепции (PoC) компания выплатила вознаграждение в размере 500 долларов.Несмотря на наличие внутренних патчей, отсутствие публичных рекомендаций (security advisories) оставляет разработчиков в уязвимом положении. Аонан Гуан отмечает, что многие пользователи продолжают применять актуальные версии инструментов, не осознавая риска перехвата полномочий их ИИ-ассистентами.